ZFS bringt alles mit, was man für eine solide Datensicherung braucht: Snapshots sind atomar und sofort erstellt, und mit zfs send lassen sie sich über SSH auf ein anderes System replizieren. Nach einem initialen Vollabgleich werden nur noch die Differenzen übertragen.

Der Ablauf:

- Snapshot auf dem Quellsystem anlegen

- Ziel-Dataset auf dem Backup-Server erstellen

- Snapshot per SSH ins Ziel schieben (Vollabgleich)

- Weitere Snapshots anlegen und nur die Differenz übertragen

Snapshot erstellen

Auf dem Quellsystem — hier ein FreeBSD-Notebook — einen rekursiven Snapshot anlegen:

zfs snapshot -r tank/usr/home/kernel@2014-10-12

Prüfen:

zfs list -t snapshot tank/usr/home/kernel NAME USED AVAIL REFER MOUNTPOINT tank/usr/home/kernel@2014-10-12 20,0M - 96,9G -

Initialer Vollabgleich

Auf dem Backup-Server ein Ziel-Dataset anlegen:

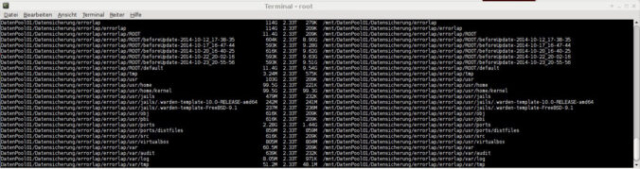

zfs create DatenPool01/Datensicherung/errorlap

Den Snapshot per SSH ins Ziel schieben — -R sendet rekursiv alle Datasets und Properties mit:

zfs send -R tank/usr/home/kernel@2014-10-12 \ | ssh root@backup-server zfs recv -Fduv DatenPool01/Datensicherung/errorlap receiving full stream of tank/usr/home/kernel@2014-10-12 into DatenPool01/Datensicherung/errorlap/usr/home/kernel@2014-10-12 received 98.4GB stream in 5298 seconds (19.0MB/sec)

Inkrementelle Sicherung

Neuen Snapshot anlegen und nur die Differenz zum vorherigen übertragen:

zfs snapshot -r tank/usr/home/kernel@2014-10-12-02 zfs send -R -i tank/usr/home/kernel@2014-10-12 tank/usr/home/kernel@2014-10-12-02 \ | ssh root@backup-server zfs recv -Fduv DatenPool01/Datensicherung/errorlap receiving incremental stream of tank/usr/home/kernel@2014-10-12-02 into DatenPool01/Datensicherung/errorlap/usr/home/kernel@2014-10-12-02 received 991MB stream in 59 seconds (16.8MB/sec)

991 MB statt 98 GB — das ist der Vorteil inkrementeller Snapshots.

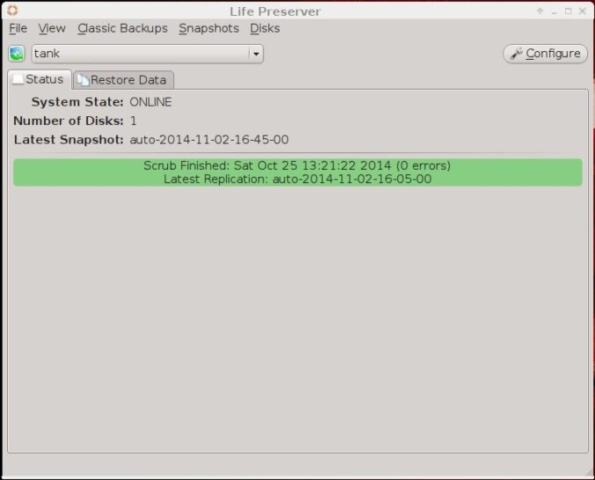

Automatisierung

Dieser Ablauf lässt sich per Skript und Cronjob vollständig automatisieren. Mit automatischen ZFS-Snapshots und SSH-Key-Authentifizierung kann man alle 15 Minuten inkrementell sichern — bei passender Internetanbindung auch standortübergreifend. Falls beim inkrementellen Transfer ein cannot receive incremental stream auftaucht, hilft der Beitrag zur Fehlerbehebung mit zfs recv -F.

Wer das Backup auf eine verschlüsselte USB-Platte statt auf einen Server schieben will, findet dort die geli-Anleitung dazu.

Fragen? Einfach melden.